35 Prozent der Unternehmen vertrauen Künstlicher Intelligenz, die nicht wirklich zuverlässig ist. Gleichzeitig bleibt das Potential vertrauenswürdiger intelligenter Systeme oft ungenutzt. Auch die Governance lässt zu wünschen übrig, wie eine IDC-Studie zeigt.

Trustworthy AI: Das Vertrauen der Unternehmen in Künstliche Intelligenz (KI) setzt oft an der falschen Stelle an, und das wiederum bremst den Nutzen dieser Technologie. Laut einer Studie des Marktforschers IDC im Auftrag des Analytics-Spezialisten SAS arbeiten lediglich 9 Prozent der Unternehmen bei Künstlicher Intelligenz mit gut abgesicherten Systemen. Fast jedes zweite Unternehmen weltweit befindet sich demnach in einem Vertrauensdilemma.

Die Studie basiert auf einer weltweiten Umfrage mit 2.375 Teilnehmern aus Nord- und Südamerika, Europa, Asien, dem Nahen Osten und Afrika. Befragt wurden IT-Fachleute und Führungskräfte aus unterschiedlichen Branchen. Dazu zählen Bereiche, die traditionell als Vorreiter der Digitalisierung gelten – darunter Banken, Versicherungen, Life Sciences und der öffentliche Dienst.

Generative KI genießt ein sehr hohes Vertrauen

Ein wichtiges Ergebnis der Studie: Generative Künstliche Intelligenz genießt ein deutlich höheres Vertrauen als klassische Machine-Learning-Modelle: Während 14,4 Prozent der Teilnehmer nach eigener Angabe dem Machine Learning vollständig vertrauen, sind es bei ChatGPT & Co 44 Prozent. Als Mathematikerin überrascht mich dieses Ergebnis“, sagt Dr. Nicole Tschauder, Analytics Expert Presales bei SAS, die im Webcast die Studie vorstellt. „Machine-Learning-Modelle sind zwar sehr komplex, haben aber eine klar definierte Struktur und einen transparenten logischen Aufbau. Wie hingegen generative Künstliche Intelligenz zu ihrem Ergebnis kommt, ist oftmals sehr undurchsichtig.“ Das Vertrauen der Anwender setzt demnach an der falschen Stelle an.

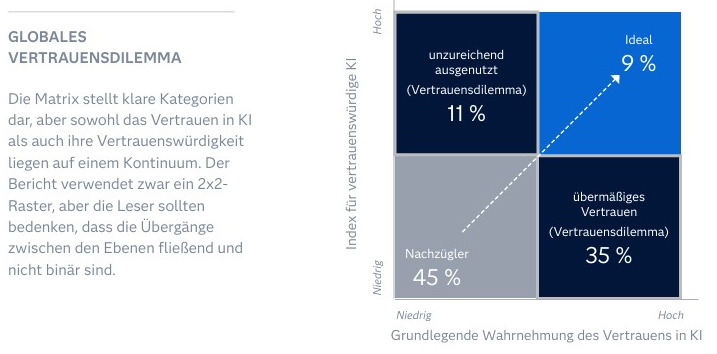

Die zentrale Erkenntnis der Studie betitelt SAS mit dem Begriff „Vertrauensdilemma“. Während international 35 Prozent der Unternehmen intelligenten Systemen vertrauen, die nicht wirklich zuverlässig oder ausreichend geprüft sind, bleibt das Potential von vertrauenswürdiger, gut kontrollierter Künstlicher Intelligenz oft ungenutzt. Ähnliche Werte zeigen sich auch in deutschen Unternehmen. Eine Matrix aus der Studie ordnet Unternehmen in vier Quadranten ein – je nachdem, wie sehr sie ihren intelligenten Systemen vertrauen und wie vertrauenswürdig diese Systeme tatsächlich sind. Auf der einen Achse steht das wahrgenommene Vertrauen in Künstliche Intelligenz, auf der anderen die objektive Vertrauenswürdigkeit der eingesetzten Lösungen.

Geprüfte intelligente Systeme sind eine Minderheit

Wie die Matrix zeigt, lässt sich lediglich ein kleiner Teil der Unternehmen im Idealzustand verorten. 9 Prozent der Befragten nutzen nachweislich inhaltlich geprüfte intelligente Systeme und vertrauen den Ergebnissen. 35 Prozent der Unternehmen hingegen vertrauen Systemen, die nach objektiven Maßstäben nicht ausreichend geprüft oder kontrolliert sind. Das stellt ein Risiko dar und kann zu Fehlentscheidungen führen. Umgekehrt haben 11 Prozent der Unternehmen zwar Zugang zu intelligenten Systemen, allerdings vertrauen sie deren Ergebnissen zu wenig und verschenken so Potential. Der größte Teil der Unternehmen, nämlich die Nachzügler mit 45 Prozent, bietet seinen Mitarbeitern bislang keine vertrauenswürdige Künstliche Intelligenz an. Gleichzeitig setzen sie nur wenig Vertrauen in die Technologie. So bleiben viele Potentiale ungenutzt. „Fast die Hälfte der Unternehmen vertraut entweder unsichere IT-Systeme zu viel oder nutzt geprüfte und abgesicherte Künstliche Intelligenz nicht ausreichend“, erläutert Tschauder.

Ohne Governance bleibt Trustworthy AI oft ungenutzt

Die Nutzung intelligenter IT-Systeme nimmt weiterhin rasant zu. Das gilt insbesondere für ChatGPT & Co, die etablierte Systeme wie Machine Learning klar in den Schatten stellen. (81 Prozent versus 66 Prozent). Trotz des sehr hohen und teilweise fehlgeleiteten Vertrauens in Künstliche Intelligenz äußern die Befragten hinsichtlich ChatGPT & Co große Bedenken: 62 Prozent misstrauen dem Datenschutz 57 Prozent der Transparenz und Erklärbarkeit und 56 Prozent der ethischen Nutzung.

Aktuell tun Unternehmen wenig, um die Risiken einzuhegen. Sowohl die Investitionen in gesicherte Frameworks für KI als auch Maßnahmen zur Sicherstellung von Trustworthy AI haben selten Priorität. Das Aufsetzen einer Governance verorten lediglich 2 Prozent der Befragten unter den Top-3-Aufgaben. Nicht einmal jeder Zehnte will Richtlinien für den verantwortungsvollen Einsatz intelligenter IT-Systeme erstellen.

IT-Infrastruktur und Datenqualität als Fallstricke

Je autonomer intelligente Systeme agieren und je tiefer sie in kritische Prozesse integriert werden, desto entscheidender sind smarte Datenstrategien. Nur so lassen sich Produktivitätssteigerungen realisieren und Risiken minimieren. Die IDC-Studie identifiziert drei Haupthürden: schwache Dateninfrastruktur, lückenhafte Governance und mangelhafte Expertise in Künstlicher Intelligenz. Fast die Hälfte der Unternehmen nennt eine dezentrale Datenbasis oder nicht optimierte Cloud-Datenumgebungen als Haupthindernis für eine erfolgreiche Einführung intelligenter IT. Darauf folgen das Fehlen umfassender Data-Governance-Prozesse (44 Prozent) und der Rückgang von Spezialisten im Unternehmen (41 Prozent).

📌 Datenmanagement für erfolgreiche KI-Projekte

Damit Künstliche Intelligenz zuverlässige Ergebnisse liefert, müssen Daten vollständig, konsistent und gut strukturiert vorliegen. In der Praxis scheitern viele KI-Initiativen jedoch an fragmentierten Datenlandschaften, fehlender Governance oder unzureichender Datenqualität.

Die Datenmanagement-Beratung von Trovarit unterstützt Unternehmen dabei, Datenstrukturen zu analysieren, Datenflüsse zu optimieren und eine belastbare Grundlage für Analytics- und KI-Anwendungen zu schaffen.

Im Hinblick auf das Datenmanagement bei Projekten rund um Künstliche Intelligenz stellt der Zugriff auf relevante Datenquellen für 58 Prozent der Unternehmen die größte Herausforderung dar. Darüber hinaus stehen Probleme mit Datenschutz und Compliance (49 Prozent) sowie Datenqualität (46 Prozent) einer erfolgreichen Implementierung im Weg.

Ohne Transparenz sinkt die Rendite

Ohne straffe Governance für Künstliche Intelligenz nimmt das Vertrauensdilemma weiter zu, und das hat betriebswirtschaftliche Folgen: Unternehmen, die entweder zu wenig in vertrauenswürdige Künstliche Intelligenz investieren oder ihr Vertrauen nicht durch Governance und Transparenz absichern, erzielen laut Studie geringere Renditen auf ihre Investitionen als diejenigen, die auf Sicherheit und Governance setzen. Lediglich 9 Prozent der Befragten investieren sowohl in Qualität als auch in Vertrauen. Genau diese profitieren am meisten von Künstlicher Intelligenz, zum Beispiel durch verbesserte Kundenerlebnisse und mehr Innovation. Jürgen Frisch