Bei aller Begeisterung weckt Künstliche Intelligenz bei Unternehmen auch Bedenken. SAS schafft Abhilfe: Model Cards überwachen die Performance analytischer Modelle, während ein spezieller Service Kunden beim sicheren und ethischen Einsatz der Technologie berät.

Vertrauensbildung: SAS, Anbieter von Lösungen für Analytics und Künstliche Intelligenz, erweitert seine Produktpalette um Funktionen für einen verantwortungsvollen Einsatz von Künstlicher Intelligenz. Sogenannte Model Cards und AI Governance Advisory Services unterstützen Unternehmen dabei, sich im komplexen Umfeld von Algorithmen zurechtzufinden, Risiken zu minimieren und ihre Ziele umzusetzen. All das passiert im Einklang mit den Richtlinien für einen ethisch vertretbaren Einsatz der Technologie und mit den Verbrauchererwartungen.

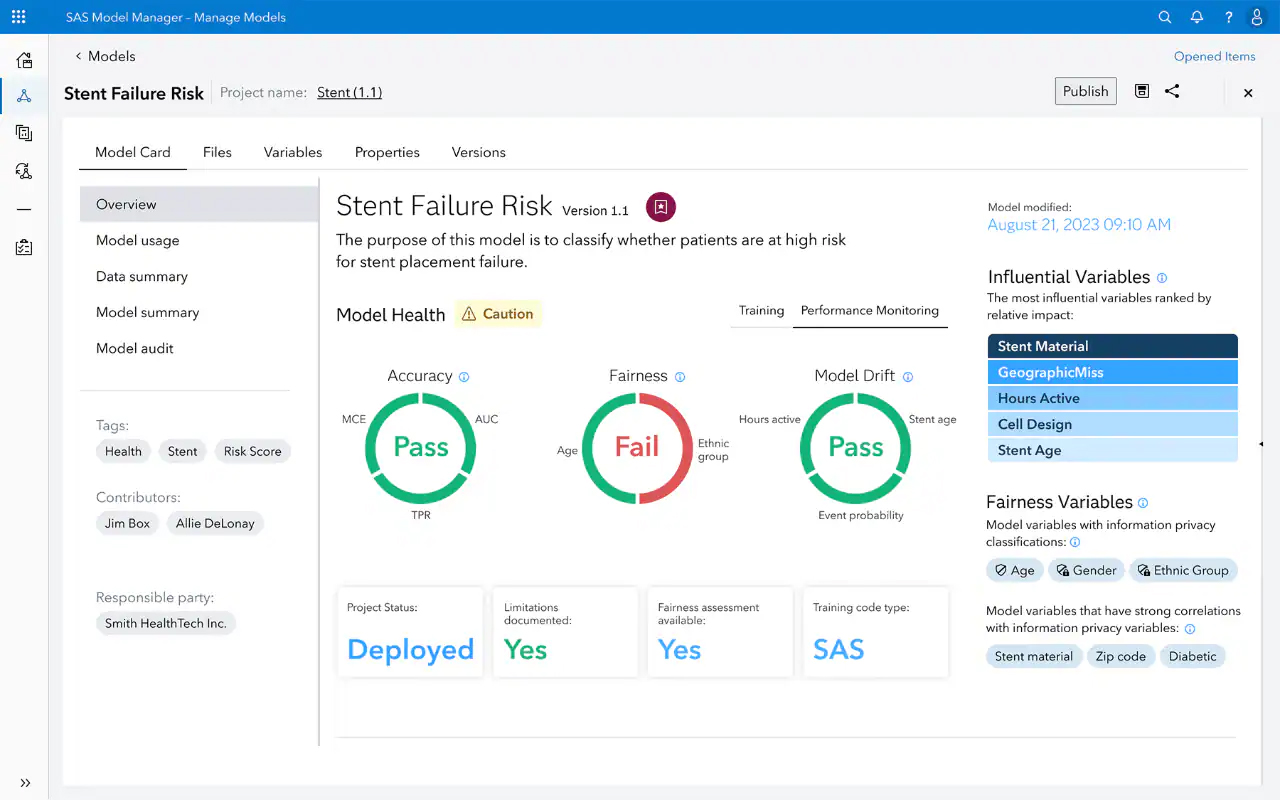

Die SAS Model Card gibt Einblick in den Status, die Zuverlässigkeit und die Performance eines analytischen Modells im Hinblick auf ausgewählte Metriken und Variablen. „Unsere Kunden sind von den Möglichkeiten der Künstlichen Intelligenz begeistert – gleichzeitig sind sie aber unsicher, wie sie diese am besten nutzen“, erklärt Reggie Townsend, Vice President Data Ethics Practice bei SAS. „Sie stellen Fragen in Bezug auf verantwortungsvolle und ethische Künstliche Intelligenz. Unsere Aufgabe ist es, ihnen die Tools und die Beratung zu geben, damit sie die Technologie so integrieren, dass sie ihre Profitabilität steigern und gleichzeitig Schaden vermeiden.“

Model Cards bewerten die Algorithmen

Automatisch generierte Model Cards in SAS Viya sorgen künftig dafür, dass alle Beteiligten – vom Entwickler bis zum Vorstandsvorsitzenden – auf dem gleichen Kenntnisstand hinsichtlich der Performance und Zuverlässigkeit von analytischen Modellen sind.

Die im Laufe des Jahres verfügbaren Model Cards funktionieren ähnlich wie Nutri-Scores bei Lebensmitteln: Sie bewerten die Modelle Künstlicher Intelligenz im Hinblick auf Genauigkeit, Fairness und Abweichungen, die sich im Laufe der Zeit ergeben. Weiterhin umfasst die Beurteilung Details zu Governance, darunter Zeitpunkt und Verantwortlichkeiten bei der Erstellung, sowie zur Nutzung, einschließlich Use Cases außerhalb des vorgegebenen Rahmens. Auch Nutzungseinschränkungen werden abgebildet – das wird spätestens dann relevant, wenn Transparenz und Modellprüfung Bestandteil regulatorischer Vorgaben werden. Das Tool generiert die Model Cards automatisch und unterstützt auch mit Open-Source-Programmiersprachen erstellte Modelle, zunächst für Python.

„Die Algorithmen für Künstliche Intelligenz lassen in Ihrer Leistung im Lauf der Zeit nach“, berichtet Josefin Rosén, Principal Trustworthy AI Spezialist in der globalen SAS Data Ethics Practice. „Die Model Cards zeigen den Verantwortlichen auf, wann sie ein Modell neu trainieren sollten.“

Ein Advisory Service berät Unternehmen

Bei aller Begeisterung für Künstliche Intelligenz nehmen die Bedenken der Unternehmen zu, wie sie ihre Daten produktiv und gleichzeitig sicher und nachhaltig nutzen. SAS bietet seinen Kunden mit dem AI Governance Advisory einen Service an, der hier Klarheit schafft. In der Beratung definiert SAS zusammen mit dem Unternehmen, was AI Governance speziell für die jeweilige Organisation heißt.

In Pilotversuchen haben mehrere Unternehmen das AI Governance Advisory getestet. Die Ergebnisse umfassten eine höhere Produktivität, ein besseres Vertrauen in die Datennutzung, größere Chancen für Gewinnung und Bindung von Top-Talenten sowie einen Boost für das Markenimage. Frühzeitig allen regulatorische Vorgaben zu entsprechen, schaffe Wettbewerbsvorteile und erlaube es Unternehmen, agil neue Märkte zu erschließen.

Steven Tiell wird den neuen Geschäftsbereich als Global Head of AI Governance bei SAS leiten. Er verfügt über umfassende Expertise für ethische Künstliche Intelligenz, unter anderem als Verantwortlicher für Global Data Ethics and Responsible Innovation Practice bei Accenture.

Anzeige | Fachartikel erschienen auf www.trovarit.com

|

|||||||||||||||

Ein Workflow steuert die Governance

Darüber hinaus hat SAS anhand von Empfehlungen des US National Institute of Standards and Technology (NIST) einen Trustworthy AI Life Cycle Workflow entwickelt, der das Risikomanagement in Verbindung mit Künstlicher Intelligenz erleichtern soll. Unternehmen bekommen ein Produktionsmodell an die Hand, das sämtliche Aktionen dokumentiert, die sie im Rahmen ihrer Sorgfaltspflicht ergriffen haben. Damit können die Verantwortlichen belegen, dass sie faire Modelle verwenden und dass ihre Prozesse keine Personengruppen benachteiligen und auch keinen Schaden verursachen.

Ein Schlüsselbaustein dafür sind repräsentative Trainingsdaten: „Daten in hoher Qualität sind eine Grundvoraussetzung für verantwortungsvolle Künstliche Intelligenz“, erläutert Josefin Rosén, „Sämtliche Projekte müssen daher damit beginnen, die notwendigen Daten zu erheben und sie im Lebenszyklus der Anwendung zu pflegen.“ Der SAS Trustworthy AI Life Cycle Workflow ist ab sofort über den SAS Model Manager Resources Github verfügbar. Jürgen Frisch